https://github.com/ChenHsing/Awesome-Video-Diffusion-Models

最近一波人工智能生成内容(AIGC)在计算机视觉领域取得了巨大的成功,而扩散模型在其中发挥了关键作用。由于其令人印象深刻的生成能力,扩散模型正逐渐取代基于GANs和自回归transformer的方法,不仅在图像生成和编辑方面,而且在视频相关研究领域都表现出了卓越的性能。

当前不足

现有的研究主要集中在图像生成环境中的扩散模型(主要做image generation)

provide only a coarse coverage of the video diffusion model or place greater emphasis on image model

扩散模型的基本原理和发展

扩散模型

扩散模型是一类概率生成模型,它们学习逆转一个逐渐降低训练数据结构的过程。

目前对扩散模型的研究主要基于三种主要的公式:去噪扩散概率模型(DDPMs),基于分数的生成模型(SGMs)和随机微分方程(Score SDEs)。

噪扩散概率模型 DDPMs

去噪扩散概率模型(DDPM)包含两个马尔可夫链:

- 一个是将数据扰动为噪声的正向链,将任何数据转换成一个简单的先验分布

- 一个是将噪声转换为数据的反向链,学习转换核来逆转前者的过程

通过先从先验分布中抽样一个随机向量,然后通过反向马尔可夫链进行祖先抽样,可以生成新的数据点。

这个采样过程的核心是训练反向马尔可夫链来匹配正向马尔可夫链的实际时间反转。

考虑一个数据分布 x0 ∽ q(x0),

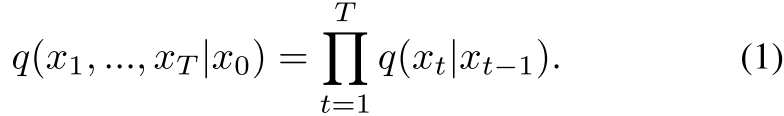

正向马尔可夫过程生成一系列随机变量 x1, x2, …, xT,其中过渡核为 q(xt|xt−1)。在给定 x0 的条件下,记作 q(x1, …, xT|x0) 的 x1, x2, …, xT 的联合分布可以分解为:

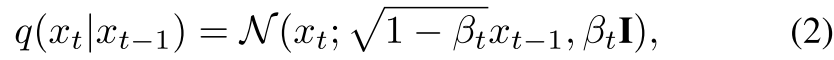

通常情况下,过渡核被设计为:

其中 βt ∈ (0, 1) 是在模型训练之前选择的超参数。

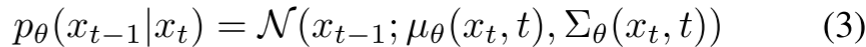

反向马尔可夫链由一个先验分布 p(xT) = N(xT; 0, I) 和一个可学习的过渡核 pθ(xt−1|xt) 参数化,其形式如下:

其中,θ 表示模型参数,均值 µθ(xt, t) 和方差 Σθ(xt, t) 由深度神经网络参数化。借助反向马尔可夫链,我们可以通过首先从噪声向量 xT ∽ p(xT) 中进行采样,然后迭代地从可学习的过渡核 xt−1 ∽ pθ(xt−1|xt) 中进行采样,直到 t = 1,生成新的数据 x0。

评分生成模型 SGMs

评分生成模型(Score-Based Generative Models,SGMs)的关键思想是通过使用不同水平的噪声扰动数据,并同时通过训练单个条件评分网络估计与所有噪声水平对应的评分。样本是通过在递减的噪声水平上使用评分函数链式生成,并结合基于评分的采样方法。在SGMs的制定中,训练和采样完全解耦。

设q(x0)为数据分布,0 < σ1 < σ2 < … < σT为一系列噪声水平。SGMs的典型示例涉及通过高斯噪声分布将数据点x0扰动为xt,其中q(xt|x0) = N(xt; x0, σ2 t I),从而得到一系列含噪数据密度q(x1),q(x2),…,q(xT),其中q(xt) := R q(xt)q(x0)dx0。噪声条件分数网络(NCSN)是一个深度神经网络sθ(x, t),用于训练估计得分函数∇xt log q(xt)。我们可以直接使用得分匹配(score matching)、去噪得分匹配(denoising score matching)和切片得分匹配(sliced score matching)等技术来训练我们的NCSN,使用扰动数据点进行训练。

对于样本生成,SGMs利用迭代方法按顺序从sθ(x,T),sθ(x,T − 1),…,sθ(x, 0)中产生样本,使用诸如annealed Langevin dynamics(ALD)等技术。

随机微分方程 Score SDEs

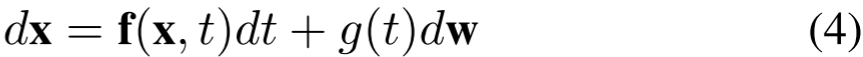

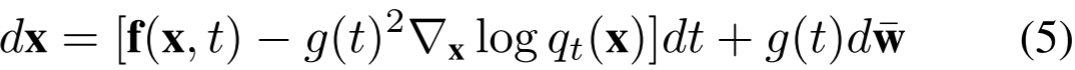

使用多个噪声尺度扰动数据是上面两个模型方法成功的关键。得分随机微分方程(Score SDEs)将这一思想进一步推广到无穷多个噪声尺度。扩散过程可以被建模为以下随机微分方程(SDE)的解:

其中,f(x, t)是SDE的扩散,g(t)是漂移函数,w是标准维纳过程(standard Wiener process)。

从x(T) ∽ pT的样本开始,并反向进行过程,我们可以通过这个逆时间SDE获得样本x(0) ∽ p0:

其中,当时间倒流时,¯w是一个标准维纳过程。一旦对于所有t知道了每个边际分布的得分,即∇x log pt(x),我们可以从方程(5)中推导出逆扩散过程,并模拟它以从p0中进行采样。

相关任务

Text-to-Video Generation

文本到视频生成旨在根据文本描述自动生成相应的视频。这通常涉及理解文本描述中的场景、对象和动作,并将其转化为一系列连贯的视觉帧,从而生成具有逻辑和视觉一致性的视频。文本到视频生成具有广泛的应用,包括自动生成电影、动画、虚拟现实内容、教育演示视频等。

Unconditional Video Generation

无条件视频生成是一项生成建模任务,其目标是从随机噪声或固定的初始状态开始生成连续且视觉上连贯的视频序列,而无需依赖特定的输入条件。与有条件视频生成不同,无条件视频生成不需要任何外部指导或先验信息。生成模型需要在没有明确输入的情况下自主学习如何捕捉时间动态、动作和视觉连贯性,以生成既真实又多样的视频内容。这对于探索生成模型从无监督数据中学习视频内容的能力和展示多样性至关重要。

Text-guided Video Editing

文本引导的视频编辑是一种利用文本描述来指导视频内容编辑过程的技术。在这个任务中,输入是自然语言描述,描述了对视频应用的期望改变或修改。系统会分析文本输入,提取相关信息,如对象、动作或场景,并利用这些信息来指导编辑过程。文本引导的视频编辑提供了一种通过使用自然语言来传达编辑意图的方式,从而促进高效且直观的编辑[29, 38, 80],潜在地减少了逐帧手动耗时编辑的需求。

数据集

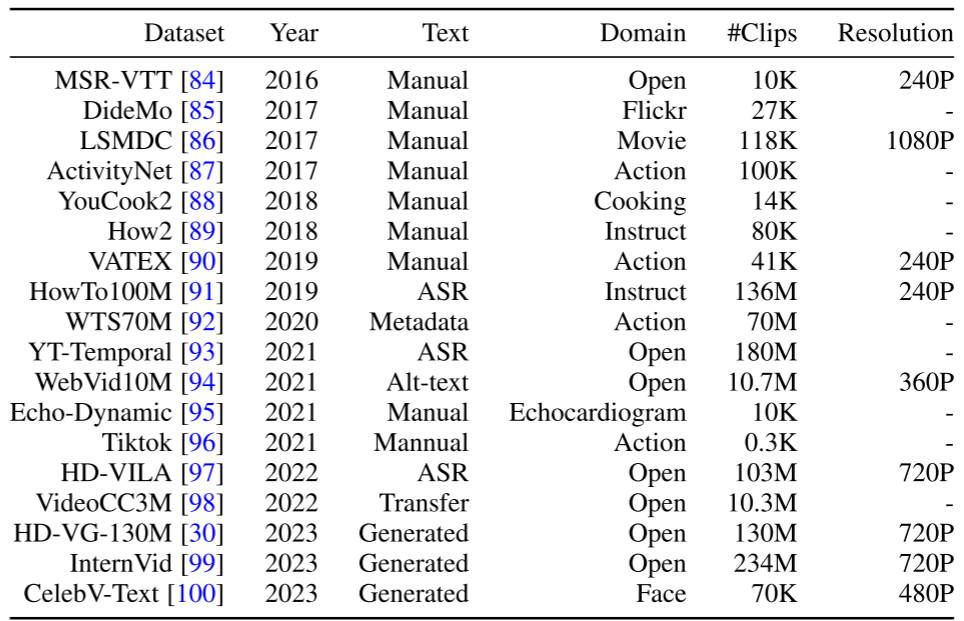

在视频生成的早期阶段,任务仅限于在低分辨率、小规模数据集上进行训练,针对特定领域,从而导致生成的视频相对单调。随着大规模视频文本配对数据集的出现,像通用文本到视频生成这样的任务开始受到关注。

视频生成的数据集主要可以分为字幕级别和分类级别。

字幕级别的数据集

字幕级别的数据集由视频和描述性文本字幕配对组成,为训练模型基于文本描述生成视频提供了必要的数据。

早期的字幕级别视频数据集主要用于视频文本检索任务[84–86],规模较小(不超过120K),并且对特定领域(如电影[86]、动作[87, 92]、烹饪[88])的关注有限。随着开放领域数据集WebVid-10M [94]的引入,文本到视频(T2V)生成的新任务开始受到关注,研究人员开始专注于开放领域的T2V生成任务。尽管WebVid-10M是T2V任务的主流基准数据集,但仍存在分辨率低(360P)和带有水印内容等问题。随后,为了提高通用文本到视频(T2V)任务中视频的分辨率和覆盖范围,VideoFactory [30]和InternVid [99]引入了更大规模(130M和234M)和高清(720P)的开放领域数据集。

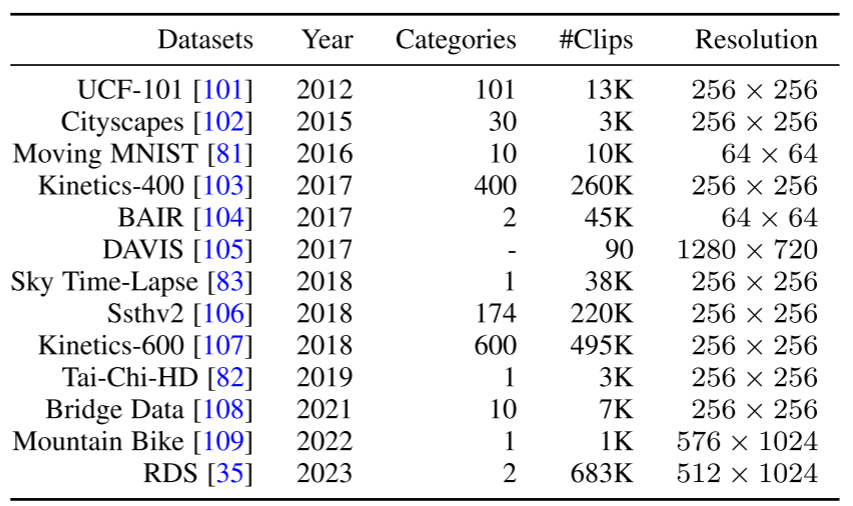

分类级别的数据集

分类级别的数据集由被分组为特定类别的视频组成,每个视频都带有其类别标签。这些数据集通常用于无条件视频生成或类别条件视频生成任务。

其中几个数据集也被应用于其他任务。例如,UCF101 [101]、Kinetics [103, 107]和Something-Something [106]是动作识别的典型基准数据集。DAVIS [105]最初是为视频对象分割任务提出的,后来成为视频编辑的常用基准数据集。在这些数据集中,UCF-101 [101]是最广泛用于视频生成的数据集,它被用作无条件视频生成、基于类别的条件生成和视频预测应用的基准数据集。它包含来自YouTube [110]的样本,涵盖了101个动作类别,包括人类运动、乐器演奏和互动动作。与UCF类似,Kinetics-400 [103]和Kinetics-600 [107]是两个涵盖更复杂动作类别和更大数据规模的数据集,但与UCF-101 [101]具有相同的应用范围。另一方面,Something-Something [106]数据集具有类别级别和字幕级别的标签,特别适用于文本条件视频预测任务 [111]。值得注意的是,这些原本在动作识别领域起关键作用的大规模数据集具有较小的规模(不超过50K)和单一类别[82, 83]、单一领域属性(数字 [81]、驾驶风景 [35, 102, 109]、机器人 [108]),因此不足以生成高质量的视频。因此,近年来,专门为视频生成任务设计的数据集被提出,通常具有独特的属性,例如高分辨率(1080P)[35]或延长的持续时间 [109, 112]。例如,Long Video GAN [109]提出了包含66个视频的马术数据集,每个视频平均持续时间为6504帧,帧率为30fps。Video LDM [35]收集了RDS数据集,其中包含683,060个持续时间为8秒的真实驾驶视频,分辨率为1080P。

评价指标

视频生成的评估指标通常可以分为定量和定性度量。

对于定性度量,一些研究中使用了人类主观评估的方法,评估者通常被呈现出两个或多个生成的视频,以与其他竞争模型合成的视频进行比较。观察者通常通过投票的方式对视频(T2V任务)的逼真度、自然连贯性和文本对齐等方面进行评估。然而,人工评估既昂贵,也存在无法完全反映模型全部能力的风险。

定性度量

图像级别评估指标

Fréchet Inception Distance(FID)[114]、峰值信噪比(PSNR)[115]、结构相似性指数(SSIM)[116]和CLIPSIM [117]。FID通过将合成的视频帧与真实的视频帧进行比较来评估生成的视频的质量。它涉及对图像进行预处理,将其归一化到一致的尺度,利用InceptionV3 [118]从真实和合成的视频中提取特征,并计算均值和协方差矩阵。然后将这些统计数据组合起来计算FID分数。

SSIM [116]和PSNR [115]都是像素级别的评估指标。SSIM 评估原始图像和生成图像的亮度、对比度和结构特征,而PSNR 是代表峰值信号与均方误差(MSE)之间比率的系数。这两个指标常用于评估重建图像帧的质量,并在超分辨率和修复等任务中应用。CLIPSIM [117]是一种用于衡量图像-文本相关性的方法。基于CLIP模型,它提取图像和文本特征,然后计算它们之间的相似性。该指标经常在文本条件的视频生成或编辑任务中使用。

缺点:图像级别的评估指标表示生成的视频帧的质量,但它们主要集中在单个帧上,忽略了视频的时间连贯性。

视频级别评估指标

Fréchet Video Distance(FVD)[121]是一种基于FID的视频质量评估指标。FVD使用在Kinetics上预训练的Inflated-3D Convnets (I3D)从视频片段中提取特征。随后,通过均值和协方差矩阵的组合计算FVD分数。

Kernel Video Distance(KVD)[123]也基于I3D特征,但它通过利用基于核的方法Maximum Mean Discrepancy(MMD)来评估生成视频的质量。

Video IS(Inception Score)[125]使用3D-Convnets(C3D)提取的特征计算生成视频的Inception得分,通常在UCF-101 上进行评估。高质量的视频具有低熵概率P(y|x),而多样性通过检查所有视频的边际分布来评估,这应该呈现出高水平的熵。

Frame Consistency CLIP Score [117]通常用于视频编辑任务中,用于衡量编辑视频的连贯性。它的计算涉及对编辑视频的所有帧计算CLIP图像嵌入,并报告所有视频帧对之间的平均余弦相似度。

VIDEO GENERATION

一般文本视频生成

基于训练的t2v扩散方法

像素级扩散

VDM (First One)将传统的图像扩散U-Net 架构扩展为3D U-Net结构,并同时使用图像和视频进行联合训练(需要成对的视频-文本数据集)。它采用的条件采样技术使得生成的视频具有更好的质量和更长的时长。它还适用于无条件生成和视频预测等任务。

Make-A-Video 引入了一种新的范式。在这种方法中,网络从成对的图像-文本数据中学习视觉-文本相关性,并从无监督的视频数据中捕捉视频动态。这种创新的方法减少了对数据收集的依赖,从而生成多样且逼真的视频。此外,通过使用多个超分辨率模型和插值网络,它实现了更高清晰度和帧率的生成视频。

Latent Diffusion Model

依赖于一维卷积或时间注意力来建立时间关系

MagicVideo 是最早使用Latent Diffusion Model (LDM,潜扩散模型)在潜空间中进行T2V生成的工作之一。通过在较低维度的潜空间中利用扩散模型,它显著降低了计算复杂度,从而加快了处理速度。引入的逐帧轻量级适配器使图像和视频的分布对齐,从而使得提出的有向注意力能够更好地建模时间关系,确保视频的一致性。

LVDM也采用了LDM 作为其骨干网络,并利用分层框架对潜空间进行建模。通过采用掩码采样技术,该模型能够生成更长的视频。它结合了条件潜空间扰动 和 无条件引导 等技术,以减轻自回归生成任务后期性能下降的问题。通过这种训练方法,它可以应用于视频预测任务,甚至生成由数千帧组成的长视频。

ModelScope 将空间-时间卷积和注意力机制融入LDM中,用于T2V任务。它采用了混合训练方法,使用了LAION 和WebVid 数据集,并作为一个开源基准方法。

Latent-Shift 专注于轻量级的时间建模。它借鉴了TSM的思想,在卷积块中将通道在相邻帧之间进行位移,以实现时间建模。此外,在生成视频的同时,这个模型还保持了原有的T2I能力。

Multi-stage T2V方法

Imagin Video 将成熟的T2I模型Imagen扩展到视频生成任务上。级联视频扩散模型由七个子模型组成,其中一个用于基础视频生成,三个用于空间超分辨率,三个用于时间超分辨率。这些子模型共同构成了一个全面的三阶段训练流程。它验证了T2I训练中采用的许多训练技术的有效性,如无分类器引导、条件增强和v-参数化 。此外,作者利用渐进蒸馏技术加速了视频扩散模型的采样时间。其中引入的多阶段训练技术已成为主流高清视频生成的有效策略。

Video LDM 训练了一个由三个训练阶段组成的 T2V 网络,包括关键帧 T2V 生成、视频帧插值和空间超分辨率模块。它在空间层次上增加了时间注意力层和三维卷积层,从而能够在第一阶段生成关键帧。随后,通过实施掩码采样方法,训练了一个帧插值模型,将短视频的关键帧扩展到更高的帧率。最后,采用视频超分辨率模型来提高分辨率。

LAVIE使用了一个由三个阶段组成的级联视频扩散模型:基础 T2V 阶段、时间插值阶段和视频超分辨率阶段。此外,它验证了联合图像-视频微调的过程可以产生高质量和创造性的结果。

Show-1 首次引入了基于像素和基于潜空间的扩散模型融合用于 T2V 生成。它的框架包括四个独立的阶段,前三个阶段在低分辨率像素级别上运行:关键帧生成、帧插值和超分辨率。值得注意的是,像素级别的阶段可以生成具有精确文本对齐的视频。第四个阶段由一个潜空间超分辨率模块组成,提供了一种经济高效的方法来增强视频的分辨率。

Noise Prior Exploration

上面的方法通过扩散模型独立地对每个帧进行去噪。

VideoFusion 通过考虑不同帧之间的内容冗余和时间相关性而脱颖而出。具体而言,它使用共享的基础噪声和沿时间轴的残差噪声对扩散过程进行分解。这种噪声分解是通过两个共同训练的网络实现的。这种方法的引入旨在确保生成帧运动的一致性,尽管可能导致多样性有限。此外,该论文还表明,使用像DALLE-2这样的T2I骨干网络来训练T2V模型可以加快收敛速度,但其文本嵌入可能面临理解长时序文本的挑战。

PYoCo承认,在视频之前直接扩展图像噪声可能在T2V任务中产生次优结果。作为一种解决方案,它复杂地预先设计一个视频噪声,并微调用于视频生成的eDiff-I模型。提出的噪声先验包括对视频中不同帧的相关噪声进行采样。作者验证了提出的混合和递进噪声模型更适合T2V任务。

数据集贡献

VideoFactory 注意到先前广泛使用的WebVid 数据集中存在低分辨率和水印的问题。作为回应,它构建了一个大规模的视频数据集HD-VG-130M,由来自开放领域的1.3亿个视频文本对组成。该数据集是通过HD-VILA 使用BLIP-2 字幕收集的,这些字幕声称具有高分辨率且无水印。此外,VideoFactory引入了交换交叉注意机制,以促进时间和空间模块之间的交互,从而改进了时间关系建模。在这个高清晰度数据集上训练,论文中提出的方法能够生成(1376 × 768)分辨率的高分辨率视频。

VidRD 引入了“重用和扩散”框架,通过重用原始潜空间表示并遵循之前的扩散过程,迭代地生成额外的帧。此外,在构建视频文本数据集时,它利用了静态图像、长视频和短视频。对于静态图像,通过随机缩放或平移操作引入动态方面。Short videos 使用BLIP-2标注进行分类,而长视频首先进行分割,然后基于MiniGPT-4 进行标注以保留所需的视频片段。在视频文本数据集中构建多样的类别和分布被证明对提高视频生成的质量是有效的。

高效训练

ED-T2V 采用LDM 作为其骨干网络,并冻结了大部分参数以降低训练成本。它引入了身份注意力和时间交叉注意力,以确保时间的连贯性。本文提出的方法在降低训练成本的同时,保持了可比的T2V生成性能。

SimDA 提出了一种参数高效的T2V任务训练方法,通过保持T2I模型的参数固定。它引入了一个轻量级的空间适配器,用于将视觉信息转移用于T2V学习。此外,它还引入了一个时间适配器,用于在较低的特征维度上建模时间关系。所提出的潜移注意力有助于保持视频的一致性。此外,轻量级的架构使得推断速度更快,并且适用于视频编辑任务。

个性化视频生成

个性化视频生成通常指根据特定主角或风格创建定制视频,以满足个人偏好或特征的视频生成需求。

AnimateDiff 注意到LoRA 和Dreambooth 在个性化T2I模型方面的成功,并希望将它们的有效性扩展到视频动画领域。此外,作者旨在训练一个可以适应生成多样化个性化视频的模型,而无需反复在视频数据集上重新训练。这涉及使用T2I模型作为基本生成器,并添加一个运动模块来学习运动动态。在推断过程中,个性化T2I模型可以替换基本T2I模型的权重,从而实现个性化视频生成。

去除伪影

“去除伪影”是指在媒体中消除或减少不希望的失真、故障或瑕疵的过程,例如图像、视频或音频。伪影可能出现为视觉异常、噪声或错误,这些都会降低媒体的质量或破坏其原本的内容。去除伪影涉及使用各种技术和算法将媒体恢复到其原始或期望的状态,提高内容的整体质量和清晰度。(T2V生成的视频中的闪烁和伪影问题)

DSDN 引入了双流扩散模型,一个用于视频内容,另一个用于动作。通过这种方式,它可以保持内容和动作之间的强对齐。通过将视频生成过程分解为内容和动作组件,可以生成具有较少闪烁的连续视频。

VideoGen 首先使用T2I模型根据文本提示生成图像,这些图像作为引导视频生成的参考图像。随后,引入了高效的级联潜空间扩散模块,采用基于流的时间上采样步骤来提高时间分辨率。与先前的方法相比,引入参考图像可以提高视觉保真度并减少伪影,使模型能够更多地专注于学习视频动态。

复杂动态建模

Text-to-Video (T2V)的生成在建模复杂动态方面面临挑战,特别是在行为连贯性方面的干扰。

Dysen-VDM 引入了一种将文本信息转化为动态场景图的方法。借助大型语言模型 (LLM) ,Dysen-VDM 从输入文本中识别关键动作,并按时间顺序进行排列,丰富场景的描述细节。此外,该模型从LLM的上下文学习中受益,赋予它具有强大的时空建模能力。这种方法在合成复杂动作方面展现出显著的优势。

VideoDirGPT 同样利用 LLM 来规划视频内容的生成。对于给定的文本输入,它通过 GPT-4 将其扩展为一个视频计划,其中包括场景描述、实体及其布局,以及实体在背景中的分布。随后,模型通过对布局进行明确控制来生成相应的视频。这种方法在复杂动态视频生成中展现出在布局和运动控制方面的显著优势。

特定领域的文本到视频生成

Video-Adapter 通过将预训练的通用T2V模型转移到特定领域的T2V任务中,引入了一种新颖的设置。通过将特定领域的视频分布分解为预训练噪声和一个较小的训练组件,它大大降低了迁移训练的成本。该方法在Ego4D 和Bridge Data 场景的T2V生成中的有效性得到了验证。

NUWA-XL 采用了粗到精的生成范式,实现了并行视频生成。它首先使用全局扩散生成关键帧,然后利用局部扩散模型在两个帧之间进行插值。这种方法使得可以生成长达3376帧的视频,从而为动画生成建立了一个基准。这项工作专注于卡通视频生成领域,利用其技术生成持续几分钟的卡通视频。

Text2Performer 将以人为中心的视频分解为外貌和动作表示。它首先利用VQVAE 潜空间对自然人类视频进行无监督训练,以解耦外貌和姿势表示。随后,它利用连续VQ扩散器对连续的姿势嵌入进行采样。最后,作者在姿势嵌入的时空域中采用了一种动作感知的遮罩策略,以增强时序相关性。

无需训练的T2VDiffusion方法

前面的方法都是基于训练的T2V方法,通常依赖于大规模数据集,如WebVid 或其他视频数据集 。而一些最近的研究 则旨在通过开发无需训练的T2V方法来减少繁重的训练成本,下面将介绍这些方法。

Text2Video-Zero 利用预训练的T2I模型Stable Diffusion进行视频合成。为了保持不同帧之间的一致性,它在每个帧和第一帧之间使用了交叉注意力机制。此外,通过修改潜空间编码的采样方法,它丰富了运动动力学。此外,该方法可以与条件生成和编辑技术(如ControlNet 和InstructPix2Pix)结合使用,实现对视频的可控生成。

DirecT2V 和Free-Bloom 则引入了大型语言模型 (LLM) ,基于单个抽象用户提示生成逐帧描述。LLM导演被用来将用户输入分解为逐帧描述。此外,为了保持帧间的连续性,DirecT2V 采用了一种新颖的值映射和双softmax过滤方法。Free-Bloom 提出了一系列的反向过程增强,包括联合噪声采样、步骤感知的注意力转移和双路径插值。实验结果表明这些修改增强了零样本视频生成的能力。

为了处理复杂的时空提示,LVD 首先利用LLM 生成动态场景布局,然后利用这些布局指导视频生成。该方法无需训练,并通过调整基于布局的注意力图来引导视频扩散模型,实现复杂动态视频的生成。

DiffSynth 提出了一种迭代中的潜空间去闪烁框架和视频去闪烁算法,以减轻闪烁并生成连贯的视频。此外,它可以应用于各种领域,包括视频风格化和3D渲染。

具有其他条件的视频生成

姿势引导的视频生成

Follow Your Pose 提出了一种由姿势和文本控制驱动的视频生成模型。它采用了两阶段的训练过程,利用图像-姿势对和无姿势视频。在第一阶段,通过使用(图像,姿势)对对T2I(文本到图像)模型进行微调,实现了姿势控制的生成。在第二阶段,模型利用未标记的视频进行学习,通过引入时间注意力和跨帧注意力机制来进行时间建模。这种两阶段的训练赋予了模型姿势控制和时间建模的能力。

Dreampose 构建了一个双路径CLIP-VAE 图像编码器和适配器模块,用以替代LDM 中原有的CLIP文本编码器作为条件组件。给定一张人类图像和一个姿势序列,这项研究可以基于提供的姿势信息生成相应的人类姿势视频。

Dancing Avatar 专注于合成人类舞蹈视频。它利用T2I模型 以自回归的方式生成视频的每一帧。为了确保整个视频的一致性,使用了一个帧对齐模块,并结合了ChatGPT 的见解,增强了相邻帧之间的连贯性。此外,它利用OpenPose ControlNet 来利用基于姿势生成高质量人体视频的能力。

Disco 涉及一种称为参考人类舞蹈生成的新颖问题设置。它利用ControlNet 、Grounded-SAM 和OpenPose 分别进行背景控制、前景提取和姿势骨架提取。此外,还利用大规模图像数据集 对人类属性进行预训练。通过结合这些训练步骤,Disco为人类特定的视频生成任务奠定了坚实的基础。

运动引导的视频生成

MCDiff 是将运动作为控制视频合成的先驱。该方法涉及提供视频的第一帧以及一系列的笔触动作。最初,利用流量完井模型根据稀疏的笔触运动控制预测密集的视频运动。随后,该模型使用稠密运动图的自回归方法来预测后续帧数,最终合成出完整的视频。

DragNUWA 同时引入文本、图像和轨迹信息,从语义、空间和时间的角度提供对视频内容的细粒度控制。为了进一步解决之前工作中对开放域轨迹控制的不足,作者提出了轨迹采样器 (Trajectory Sampler, TS),以实现任意轨迹的开放域控制,同时还提出了多尺度融合 (Multiscale Fusion, MF) 来控制不同粒度的轨迹,并采用自适应训练 (Adaptive Training, AT) 策略来生成符合轨迹的一致视频。

声音引导的视频生成

AADiff 引入了同时使用音频和文本作为视频合成条件的概念。该方法首先使用专用编码器分别对文本和音频进行编码。然后,计算文本和音频嵌入之间的相似性,并选择具有最高相似度的文本标记。选择的文本标记以prompt2prompt 的方式用于编辑帧。这种方法可以生成与音频同步的视频,而无需进行任何额外的训练。

Generative Disco 是一个旨在进行音乐可视化的文本到视频生成的人工智能系统。该系统采用了一个流水线,首先使用一个大型语言模型 ,然后使用一个文本到图像模型来实现其目标。

TPoS 将具有可变时间语义和幅度的音频输入与LDM 的基础相结合,扩展了在生成模型中利用音频模态的应用。通过客观评估和用户研究,这种方法在广泛使用的音频到视频基准测试中表现出色,凸显了其卓越的性能。

图像引导的视频生成

LaMD 首先训练一个自编码器,将视频中的运动信息进行分离。接着,训练一个基于扩散的运动生成器,用于生成视频的运动。通过这种方法,模型在运动的指导下,能够生成具有高质量感知的视频,只需提供第一帧作为输入。

LFDM 利用条件图像和文本进行以人为中心的视频生成。在初始阶段,训练了一个潜在流自编码器来重建视频。此外,在中间阶段可以使用流动预测器来预测流动运动。随后,在第二阶段,使用图像、流动和文本提示作为条件训练扩散模型,以生成连贯的视频。

Generative Dynamics 提出了一种在图像空间建模场景动态的方法。它从展现自然运动的真实视频序列中提取运动轨迹。对于单个图像,扩散模型通过一个频率协调的扩散采样过程,在傅里叶域中为每个像素预测长期的运动表示。这个表示可以转换为跨越整个视频的密集运动轨迹。当与图像渲染模块结合时,它可以将静态图像转化为无缝循环的动态视频,促进用户与所描绘对象的真实互动。

脑引导的视频生成

MinD-Video 是通过连续的功能性磁共振成像(fMRI)数据探索视频生成的开创性工作。该方法首先使用对比学习将MRI数据与图像和文本进行对齐。接下来,通过训练的MRI编码器取代CLIP文本编码器作为条件输入。通过设计一个时间注意力模块来建模序列动态,进一步增强了该方法。得到的模型能够重建具有精确语义、动作和场景动态的视频,超越了真实数据的性能,为这一领域设定了新的基准。

深度引导的视频生成

Make-Your-Video 采用了一种新颖的方法进行文本深度条件视频生成。它在训练过程中使用MiDas 提取深度信息,并将其作为条件因素进行集成。此外,该方法引入了因果性注意掩码,以便合成更长的视频。与最先进的技术进行比较表明,该方法在可控的文本到视频生成方面具有优势,展示了更好的定量和定性性能。

Animate-A-Story 中,引入了一种创新的方法,将视频生成分为两个步骤。第一步是动作结构检索,根据给定的文本提示从大型视频数据库中检索出最相关的视频。使用离线深度估计方法获取这些检索到的视频的深度图,然后用作运动引导。第二步是结构引导的文本到视频合成,通过从深度图中获取的结构运动来训练视频生成模型。这种两步法可以根据定制的文本描述创建个性化的视频。

多模态引导的视频生成

VideoComposer 专注于基于多模态条件生成视频,包括文本、空间和时间条件。具体而言,它引入了一个时空条件编码器,允许对各种条件进行灵活组合。这最终实现了多种模态的结合,例如草图、掩码、深度和运动向量。通过利用多种模态的控制,VideoComposer 实现了生成内容中更高的视频质量和改进的细节。

MM-Diffusion 是联合音频-视频生成的首次尝试。为了实现多模态内容的生成,它引入了一个分支结构的架构,其中包括两个子网络,分别负责视频和音频的生成。为了确保这两个子网络的输出之间的连贯性,设计了一个基于随机偏移的注意力模块来建立相互连接。除了在无条件音频-视频生成方面的能力之外,MM-Diffusion 在实现视频到音频的转换方面也表现出明显的适应能力。

MovieFactory 致力于将扩散模型应用于电影风格视频的生成。它利用ChatGPT 对用户提供的文本进行详细阐述,以生成用于电影生成的全面顺序脚本。此外,还设计了一个音频检索系统,为视频提供配音。通过上述技术,实现了生成多模态音视频内容的目标。

CoDi 提出了一种新颖的生成模型,具有从不同的输入模态组合中创建多样化的输出模态的能力,包括语言、图像、视频或音频。这是通过构建一个共享的多模态空间实现的,通过对不同模态之间的输入和输出空间进行对齐,促进了任意模态组合的生成。

NExT-GPT 提出了一个端到端的任意多模态LLM系统,可以实现任意多模态的输入和输出。它将LLM 与多模态适配器和多样化的扩散解码器集成在一起,使系统能够感知文本、图像、视频和音频的任意组合,并生成相应的输出。在训练过程中,它只微调了一小部分参数。此外,它引入了一种模态切换指令调整(MosIT)机制,并手动策划了一个高质量的MosIT数据集。这个数据集有助于获取复杂的跨模态语义理解和内容生成能力。

无条件视频生成

在没有额外条件的情况下生成属于特定领域的视频。这些研究的重点主要集中在视频表征的设计和扩散模型网络的架构上。

基于U-Net的生成模型

VIDM 利用了两个流:内容生成流用于生成视频帧内容,动作流定义了视频的运动。通过合并这两个流,生成了一致的视频。此外,作者采用了位置群归一化(PosGN)来增强视频连续性,并探索了隐式运动条件(IMC)和PosGN的组合,以解决长视频的生成一致性问题。

PVDM 首先训练一个自编码器将像素映射到低维潜在空间,然后在潜在空间中应用扩散去噪生成模型来合成视频。这种方法既降低了训练和推断的成本,同时又能保持令人满意的生成质量。(与LDM类似)

GDVDM 首先生成深度图视频,其中场景和布局的生成被优先考虑,而细节和纹理被抽象化。然后,生成的深度图作为条件信号用于进一步生成视频的其余细节。这种方法保留了出色的细节生成能力,特别适用于复杂的驾驶场景视频生成任务。(主要关注合成驾驶场景视频)

LEO 通过一系列流场图在生成过程中表示运动,从而在本质上将运动与外观分离开来。它通过流场图像动画器和潜在运动扩散模型的组合实现人类视频的生成。前者学习从流场图到运动编码的重构,而后者捕捉运动先验以获取运动编码。这两种方法的协同作用能够有效地学习人类视频之间的相关性。此外,这种方法可以扩展到无限长度的人类视频合成和保留内容的视频编辑等任务。

基于Transformer的生成模型

VDT 在Transformer 架构中开创性地探索了基于视频扩散模型的方法。利用Transformer的灵活可扩展性,作者研究了各种时间建模方法。此外,他们还将VDT应用于多个任务,如无条件生成和视频预测。

视频补全

VIDEO EDITING

VIDEO UNDERSTANDING

面临的挑战

未来发展趋势

- 本文作者: 李宝璐

- 本文链接: https://libaolu312.github.io/2023/10/17/视觉扩散模型综述/

- 版权声明: 本博客所有文章除特别声明外,均采用 MIT 许可协议。转载请注明出处!